Am 7. Dezember veranstaltet die Österreichische Akademie der Wissenschaften in Wien ein Symposium im Rahmen des Colloquium Digitale „Digitalisierung, Mensch und Gesellschaft“. Das Thema der Veranstaltung lautet "Digitally Sustainable? The (In)Visible Hand of Artificial Intelligence in the Agenda 2030". Victor Galaz von der Universität Stockholm ist dabei zu Gast und geht in seinem Vortrag “Intelligent Machines, Emotions, and Sustainability” auf den Einsatz von künstlicher Intelligenz und Algorithmen zur Beeinflussung menschlicher Emotionen ein. Im Interview spricht der Politikwissenschaftler über die Rolle, die solche Systeme im Kampf gegen den Klimawandel spielen, und mögliche Chancen und Gefahren.

Ihr Vortrag heißt “Intelligente Maschinen, Emotionen und Nachhaltigkeit”. Wie passen diese drei Dinge zusammen?

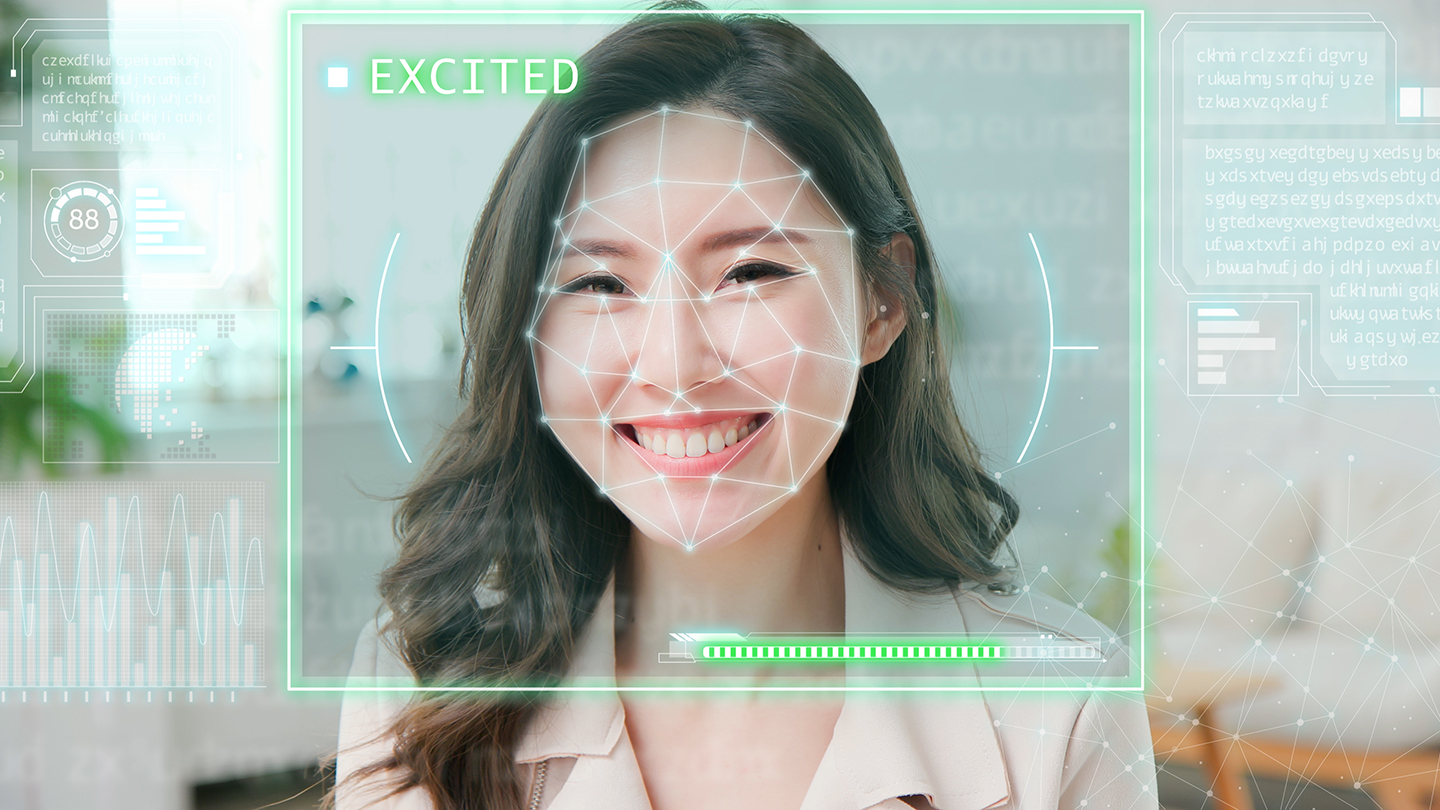

Victor Galaz: Wenn wir über die Rolle von künstlicher Intelligenz im Bereich Nachhaltigkeit sprechen, konzentrieren wir uns üblicherweise auf Werkzeuge, die der rationalen Entscheidungsfindung in wirtschaftlichen Belangen dienen und zum Beispiel den CO2-Ausstoß und den Ressourcenverbrauch minimieren. Wir wissen aber aus der Forschung, dass Emotionen eine wichtige Rolle für Nachhaltigkeitsbemühungen spielen. Wenn Menschen Empathie für andere Leute oder künftige Generationen verspüren, sind sie eher geneigt, ihr Verhalten zu ändern und umweltfreundlicher zu leben. Dazu kommt, dass die Algorithmen von digitalen Medienplattformen Bilder, Videos und Texte mit emotionalem Inhalt bevorzugen. Intelligente Systeme lernen zunehmend, Informationen über den emotionalen Zustand von Menschen zu nutzen und eröffnen so neue Möglichkeiten für die Kommunikation wichtiger Inhalte.

Intelligente Systeme lernen zunehmend, Informationen über den emotionalen Zustand von Menschen zu nutzen

Welche konkreten Beispiele gibt es dafür?

Galaz: Soziale Medien sammeln immer mehr Daten über das Onlineverhalten ihrer Nutzer. Ein Beispiel dafür sind die Like-Buttons auf den Plattformen. Gab es früher mit “Daumen hoch” oder “Daumen runter” nur zwei Möglichkeiten, um Beiträge zu bewerten, stehen Nutzern heute eine ganze Reihe von Buttons zur Verfügung, die verschiedene Emotionen transportieren. Die Plattformen sammeln diese Informationen und versuchen natürlich, sie zu nutzen. Emotionale Bindungen spielen auch bei Klimaprotesten wie den “Fridays for Future” eine wichtige Rolle. Das Gefühl der Verbundenheit zwischen den Aktivisten ist ein wichtiger Teil der Bewegung. Digitale Netzwerke spielen beim Aufbau entsprechender Strukturen mittlerweile eine wichtige Rolle, nicht nur für die Organisation von Protesten sondern auch als Kommunikationsplattformen, die Inhalte auf eine emotionalen Ebene herunterbrechen, um eine größere Reichweite zu erzielen.

KI lernt zunehmend emotionale Sprache

Können intelligente Systeme Emotionen auch direkt beeinflussen?

Galaz: Ein Projekt in Kanada nutzt neue Möglichkeiten der Bilderzeugung mit künstlicher Intelligenz, um Nutzern die Auswirkungen des Klimawandels auf ihre persönliche Umgebung vor Augen zu führen: Wenn man eine Adresse eingibt, erzeugt ein KI-System ein Bild, das zeigt, wie es dort bei einer Überflutung aussehen würde. Das ist eine starke Botschaft, die über die emotionale Ebene funktioniert. Solche AI-Systeme entwickeln sich rasend schnell weiter. So lassen sich Bilder kreieren, die emotionale Reaktionen auslösen. Es wird sehr spannend zu sehen, wie diese Technologie in Zukunft eingesetzt wird.

Als Forscher wollen wir die Zusammenhänge besser verstehen und analysieren, wie sich der Einsatz von KI-Werkzeugen weiterentwickelt.

Müssen wir uns in Zukunft auf Werbekampagnen einstellen, die unsere Emotionen automatisiert manipulieren?

Galaz: Es ist schwierig, emotionale Botschaften für einen bestimmten Zweck zu nutzen, weil das zu Abwehrreaktionen bei den Adressaten führen kann. Die Leute finden es schnell gruselig, wenn sie merken, dass sie emotional manipuliert werden. Als Forscher wollen wir die Zusammenhänge besser verstehen und analysieren, wie sich der Einsatz von KI-Werkzeugen weiterentwickelt. Wie stark der Einfluss auf Emotionen und Verhalten tatsächlich ist, ist auch eine offene Frage. Derzeit wird die Technologie hauptsächlich von kommerziellen Interessen getrieben. Die Plattformen wollen Aufmerksamkeit und die damit verbundenen Werbeeinnahmen. Das erreichen sie am besten, indem sie an unsere Emotionen appellieren. Wie man das ethisch vertretbar regulieren kann, haben wir als Gesellschaft noch nicht ausdiskutiert. Einfache Lösungen gibt es hier wohl nicht, aber wir müssen zumindest versuchen zu verstehen, was gerade passiert.

Emotionen spielen in der Kommunikation immer eine große Rolle. Was ändert sich, wenn intelligente Systeme mitspielen?

Galaz: Emotionen waren immer wichtig für Kommunikation. Die Verbindung zur Technologie hat wahrscheinlich schon mit den ersten Chatbots begonnen, die automatisiert mit Menschen interagieren können. Durch den Einsatz von Deep Learning und leistungsfähige Sprachmodelle sind solche Werkzeuge mittlerweile viel mächtiger und lernen unsere Emotionen einschätzen und zu beeinflussen.

Müssen wir uns bald vor hyperrealistischen Chatbots fürchten, die uns am Telefon etwas verkaufen wollen?

Galaz: Solche personalisierte Kampagnen, die versuchen, Einfluss auf einzelne Personen zu nehmen, sind denkbar, aber wirtschaftlich wohl kaum sinnvoll. Ein detailliertes Profil der Emotionen einer Person zu erstellen, wäre sehr aufwändig. Emotionen lassen sich einfacher im großen Maßstab über Kampagnen manipulieren, die auf große Reichweite getrimmt werden.

Manipulationsgefahr durch Emotionalisierung

Das klingt nach einem gefundenen Fressen für die Politik.

Galaz: Es gibt Hinweise darauf, dass die Politik zunehmend auf emotionale Reize setzt. Es besteht die Gefahr, dass Manipulationsmöglichkeiten durch die automatisierte Erstellung von emotionalen Inhalten zunehmen. Zudem kann die Effektivität von Botschaften heute anhand ihres Erfolgs auf sozialen Medien einfach getestet werden. Aber Emotion war für Politiker immer schon ein wichtiges Werkzeug.

Spielen neue Möglichkeiten, Emotionen zu manipulieren populistischen Strömungen in die Hände?

Galaz: Populisten stützen sich auf Angst und Nostalgie und können das natürlich nutzen, aber am Ende braucht jede Bewegung eine emotionale Komponente. Auch Greta Thunberg kommuniziert in den sozialen Medien auf einer sehr emotionalen Ebene. Es kann außerdem schnell passieren, dass die Leute genug von dieser Art der Kommunikation bekommen und das Vertrauen in die Institutionen verlieren.

Welche Chancen können sich aus technischen Zugängen zu unseren Emotionen ergeben?

Galaz: Die Verbundenheit, die wir durch digitale Technologie gewonnen haben, ist eine Möglichkeit, Empathie zu schüren. Wir können zum Beispiel direkt mit vom Klimawandel betroffenen Menschen in Kontakt treten oder Naturwunder virtuell erleben, zu denen wir vorher keinen Zugang gehabt hätten. Für Wissenschaftler bieten neue Werkzeuge die Möglichkeit, das abstrakte Konzept zukünftiger Folgen des Klimawandels zu kommunizieren, um so zu kommunizieren, dass tatsächlich eine persönliche emotionale Verbindung entsteht.

Und was sind die größten Risiken?

Galaz: Die ethischen Aspekte sollten wir nicht auf die leichte Schulter nehmen. Das Sammeln von Daten über Emotionen wirft viele Fragen auf, vergleichbar mit der Situation bei medizinischen Daten. Wir sind als Gesellschaft noch nicht so weit, gemeinsame Regeln für den Umgang mit dieser Technologie zu gestalten, aber wir müssen die Probleme jetzt diskutieren, weil die Systeme ja bereits genutzt werden. An den rechtlichen Rahmenbedingungen wird bereits gearbeitet. In einzelnen US-Bundesstaaten und auf europäischer Ebene gibt es bereits Regeln für die Nutzung emotionaler Daten. So dürfen Online-Plattformen, die Mini-Jobs vermitteln, bestimmte Informationen über den emotionalen Zustand ihrer Nutzer nicht sammeln.